近年来,人工智能在国内外掀起了新一轮技术创新的浪潮,人工智能正在成为产业革命的新风口。据BBC预测,到2020年,全球人工智能市场规模可达到1190亿元。艾瑞咨询预测,到2020年,中国人工智能市场规模约91亿元。

目前,政策、经济、人才、技术各方面都为人工智能提供了很好的条件:

(1) 政策:人工智能进入国家战略层面。国务院在《关于积极推进“互联网+”行动的指导意见》中将人工智能推上国家战略层面。在国家“十三五”规划的“科技创新-2030项目”中,智能制造和机器人被列为重大发展工程。2016年,为加快人工智能产业发展,国家发展改革委、科技部、工业和信息化部、中央网信办制定了《“互联网+”人工智能三年行动实施方案》。2016年科大讯飞、华为等行业知名企业,在深圳共同发布中国《人工智能深圳宣言》,积极探索政、产、学、研、用合作机制,推动人工智能产业的协同发展。2017年十二届全国人大会议中,国务院总理李克强提出,要推动内地与港澳深化合作,研究制定“粤港澳大湾区”城市群发展规划,提升在国家经济发展和对外开放中的地位与功能。

(2) 经济:互联网经济高速发展,据艾瑞咨询估计,2015年中国网络经济增长约33%,市场规模超过千亿,并有持续增长趋势。2014年开始,投资机构在人工智能领域投资金额,数量均大幅度增加。据咨询公司Venture Scanner统计,2016年全球人工智能公司已突破1000家,融资高达48亿美元。

(3) 人才:在中国科研投入占全球的20%,仅次于美国,信息技术互联网领域是国家的重点投入对象,近五年,科研人员保持20%的持续增长,为人工智能的发展提供了充足的人才支撑。

(4) 技术:目前我国已在计算机视觉,智能语音等领域实现了技术突破,处于国际领先水平。国内具有代表性的公司或机构包括:百度,阿里巴巴,腾讯,科大讯飞,旷视科技,商汤科技等。

在人工智能技术中,智能语音技术是一个重要的分支,是人机交互过程中不可或缺的部分。语音技术包含:语音识别、语音合成、声纹识别、语音评测、语音转换等,其中发音检错纠错和语音转换技术近期有了新的突破。

发音检错纠错

英语是当今世界上最为通用的语言,其重要性已为所有人深刻领会。由于英语的强势地位,目前被超过100个国家作为外语教学的第一外语。据EF英孚教育发布的《2015年英语熟练度指标报告》显示,中国人每年花费千亿元用于英语培训,但实际效果依然不佳,在全球70个国家和地区中,中国大陆排名47位。虽然英语水平仍处于低熟练程度,但近年来呈现明显增长趋势。据中国社会调查所公布的中国居民消费调查报告统计,中国已成为全球英语培训领域增长速度最快的市场,年增长率高达12%。在如此广阔的英语培训市场下,线下英语培训面临着师资数量短缺,教师口语水平参差不齐、“添鸭式”与“应试式”教学以及无法有效改善口语听力水平等存在诸多矛盾。

另外,中文拼音与英语音标发音方法和位置有所区别,但许多中国学生在刚接触英语时习惯用熟悉的中文拼音来标注、记忆英语单词的发音。久而久之,养成了不良的发音习惯,同时还由于中国学生普遍腼腆,上课口语训练时间不足,课后口语练习得不到反馈,以及大部分英语老师的发音不标准等因素造成了中国学生的发音不标准。由于发音一直是中国学生学习英语时一个难关,有许多人愿意为了纠正发音,支付高昂的学费,请外教纠正自己的发音。随着移动在线语言学习的兴起,催生了AI语音评测,促进了AI纠音技术的发展。

虽然目前市场上有许多在线的英语学习软件,但大多数都只是简单地播放音视频学习资料,学生跟读,系统播放录音。只有为数不多的软件,具备打分评测的功能,而评测的准确性,一直为学生所诟病。因此,市场迫切需要能提供高可靠的打分评测技术。

图1 目前市面相关产品

另外,除了提供高可靠的打分评测技术,学生也迫切需要具体的发音诊断的反馈建议。因为单纯的打分评测技术,只能够指出学生的发音不够好,但学生并不理解自己的发音错误在哪里,及应该如何改进发音。比如把读错的单词标红出来,需反复对比原声才能分析出错误的细节,这在明显读错的情况下还好实现,如:steak/steik/,读错为/sti:k/。

但以下情况就非常困难了,特别是学习者不熟悉英语的拼读发音规则,语法的条件下。

(1)如records/'rekɔːdz/,读错为/'rekɔːds/。

(2)如the apple /ði/,读错为/ðə/(the在辅音前发 /ðə/,元音前发 /ði/)。

(3)长短音如book/bʊk/,读错为/buːk/;Lily/'lɪli:/,读错为/'li:li:/。

如果学习者在反复练习过程中不能及时发现具体的错误细节,会降低学习效率和兴趣,甚至反复错误发音,产生错误的肌肉记忆。这个问题,在学术研究上被称为“错误发音检测及诊断”。为了解决这个问题,在过去的十多年中,世界上的许多顶级科研机构都投入了大量的人力物力,其中最具影响力的包括香港中文大学,清华大学,台湾大学,美国麻省理工大学,新加坡资讯通信研究院,微软亚洲研究院,IBM等等。

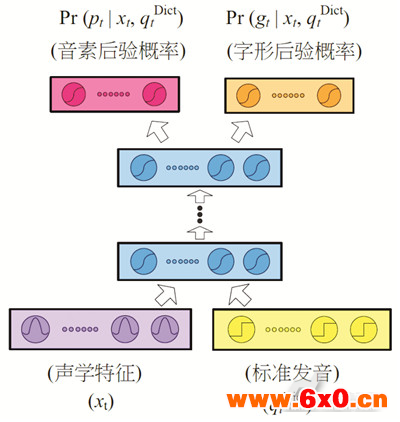

图2 多任务学习的声学音素模型

“错误发音检测及诊断”的难点在于它们不同于一般的语音识别技术,对于训练模型和训练数据有着更严格的要求,并且不同母语的人群在学习英语的过程中易出现的错误也不同。因此要收集大量以中文为母语的人群的英文录音,并邀请专业人士对数据进行了人工标注。随着深度学习的发展,和多年的技术积累,声希科技李坤博士等人实现了此领域的重大突破,利用深度神经网络对声学特征和标准发音进行预测,输出后验概率(如图2所示)。不仅实现了对错误发音的检错和诊断,还能对重音,语调,流利度等实现评测(如图3所示)。

图3 发音,重音,音调检错纠错技术展示

语音评测技术的突破让AI系统成为私人发音老师成为可能。当系统知道学生具体的错误后,就能自动匹配相应的教学内容和练习题目,实现更精准的自适应推荐。如果新技术能得到普及,那将大大改善中国学生的发音现状,特别是解决农村乡镇地区的教育资源和语言环境问题。

另外,随着中国在国际上地位的提升,特别是一带一路的推动,愈来愈多外国人开始学习汉语,资料显示全球学习汉语的外国人已经超过1亿。而中文发音是中文学习中的重大难题,发音评测的新技术能针对外国中文学习者的发音错误的特点,利用可靠的发音自动评测方法及时、准确地纠正发音错误,可以大大提高中文辅助语音教学系统的教学效果。

语音转换

随着语音信号处理技术(包括语音识别和语音合成)的发展,在人机交互中语音已成为最自然最方便交互方式之一。语音不仅可以传递信息,也可以传递情感、态度和说话人的个人特征。其中,说话人的个人特征在我们日常交流中扮演重要角色,它允许我们在电话、广播节目、电影等媒体中区分说话人。除此之外,智能语音助手变得越来越流行,比如 Apple Siri、Microsoft Cortana、Amazon Alexa。大多数人对语音助手的音色有很强的偏好,因此生成具有特别音色的语音在人机交互领域非常重要。

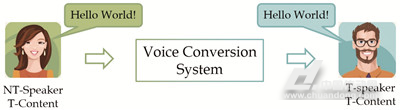

图4 语音转换示意图

上述场景可归结为语音转换(Voice Conversion)问题,目标在于修改非目标说话人Non-target(NT)Speaker的语音音色,使其听起来像是目标说话人Target(T)Speaker的语音,但同时保持说话的内容T- Content不变(如图4所示)。

深度学习是人工智能领域划时代的革命技术,随着深度学习的应用,合成语音和转换语音的自然度和流畅度都有很大的提升。在语音合成领域,Google Deepmind 在2016年提出的Wavenet模型将自然度提高了50%。2017年Yoshua Bengio等提出端对端合成模型,使得模型可以从文本直接生成语音而不需要前端预处理。在国内,康世胤等在2013年将深度信念网络(Deep Belief Networks)用于语音合成,为学界业界最早之一。2017年,百度研究院提出Deep Voice模型改进了语音合成速度,实验证明该模型可以用于实时语音合成。

语音转换技术的最早尝试在1988年由Abe等学者完成。在1988年到2013年期间,大部分算法基于Codebook Mapping、Frequency Warping、Unit Selection、Gaussian Mixture Models。2013年开始,深度学习被应用到语音转换中,Nakashika等将深度神经网络(Deep Neural Networks)用于在高维空间中,将非目标说话人语音映射到目标说话人语音。虽然语音转换技术较以前有很大提升,但是语音自然度和音色相似度方面仍有很大的改善空间,另外在实用适用性方面不够完善比如只能支持特定人到特定目标人的转换(一转一),以及需要严苛的数据条件,需要目标人上千句的语音数据。

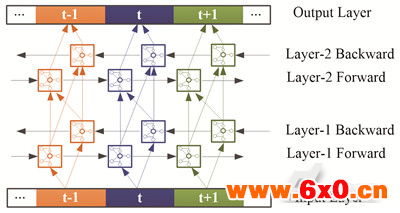

图5 深度循环神经网络(DBLSTM-RNNs)示意图

在2015年,声希科技联合创始人孙立发博士团队等利用深度循环神经网络(DBLSTM-RNNs)来改进转换语音的自然度和流畅度(如图5所示),传统的深度神经网络DNN只能映射单一帧到单一帧之间的关系忽略了语音连续信号帧之间的相关性,DBLSTM-RNNs很好的解决了这个问题从而可以提升自然度和流程度。

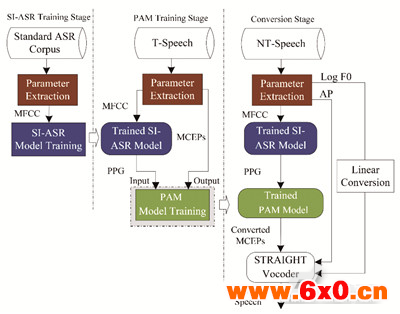

图6 非平行语句多对一语音转换框架图

在2016年,孙立发博士等利用从语音识别模型提取到的后验概率来映射非目标说话人和目标说话人(如图6所示),可以实现多对一的转换并且降低了对训练数据的要求,大大提高了语音转换技术的实用性。语音转换具有广泛的应用:

(1)个性化语音合成。将语音转换技术与现有的语音合成系统结合,生成用户想要的音色。

(2)计算机辅助语言学习中的个性化语音反馈。目前语言学习者在学习的过程中参照的标准发音是统一的录音,语音转换系统可以合成出具有用户自己音色的标准发音,帮助用户进行跟读对比。

(3)机器翻译。机器翻译技术可以将一句语音从一种语言翻译到另外一种语言,而语音转换技术可以辅助机器翻译,让翻译后的语音仍然保持说话人的音色。

(4)语言障碍患者的个性化辅助。语言障碍为中风、帕金森等疾病的常见后遗症。语言障碍会影响患者的日常交流和个性化和情感表达。语音转换技术加上语音合成技术可以辅助患者进行正常的语音沟通,并且找回自己声音的音色。

(5)娱乐领域。潜在应用包括电影电视配音,游戏配音,导航配音等。

孙立发博士

香港中文大学博士,中国科学技术大学学士,曾任硅谷苹果实习生。研究方向主要为语音转换,语音合成,2016年荣获顶级国际会议ICME2016唯一一个最佳论文奖。曾任香港中国创新创业协会理事, 全球青年领导力联盟GYL香港社区联席主席,香港中文大学内地学生学者联谊会CSSA主席。

现为声希科技联合创始人兼CEO,专注于人工智能+在线教育,2017年声希科技荣膺中国创新创业大赛全国第五名,为广东省唯一一个入选总决赛的初创企业,为唯一一个入选总决赛的智能语音企业。

李坤博士

曾任香港中文大学研究助理,博士后研究员。拥有5项国内及国际专利,发表超过15篇学术论文。其论文曾获 ICME 2016年度最佳论文奖,并荣登IEEE/ACM transactions期刊封面(2017年)。同时是多家国际顶级语音期刊审稿人,包括IEEE/ACM transactions, Computer Speech & Language, The Journal of the Acoustical Society of America.

李坤博士于2016年创立声希科技,主要负责开发基于人工智能的语言学习系统。他带领的团队获得多项政府及专业团体的资助,包括深圳科创委和香港数码港的创业资助,累计金额超过100万人民币。其团队屡次摘得创业大奖,包括深圳市创新创业大赛互联网行业三等奖、中国创新创业大赛互联网行业三等奖等。目前,李坤博士开发的技术已成功应用于百词斩、缤纷英语、玩瞳等多家教育公司的产品。

QQ交流群

QQ交流群